车东西(公众号:chedongxi)

作者 | Janson

编辑 | 志豪

在2026北京车展上,智能汽车产业的竞争焦点正在变得愈发清晰。

当大模型加速上车、端侧AI推理成为热点、L3/L4探索持续升温,过去更多停留在参数表里的芯片能力,开始真正走到产业舞台中央。

无论是座舱智能体、城区辅助驾驶,还是面向更高阶场景的Robotaxi,背后都指向同一个现实问题——汽车需要的不单纯是“更高算力”,而是更适配下一代模型、更适合复杂场景部署、也更利于量产落地的芯片平台。

也正是在这样的背景下,黑芝麻智能在北京车展及相关论坛上重点展示、全新亮相的华山A2000家族,成为现场颇受关注的一条技术主线。

今天,行业需要的已经不只是更高的峰值算力,而是一套真正面向下一代AI模型设计的端侧算力平台。

这是一种“既要又要”的需求——既要覆盖从座舱AI化、城区辅助驾驶到L4级Robotaxi的多层次需求,又要兼顾能效、感知、安全与量产效率,还要为VLA、世界模型等新范式预留足够空间。

也正是在这样的背景下,黑芝麻智能华山A2000家族的意义开始显现。

作为专为下一代AI模型设计的高算力芯片平台,华山A2000家族以统一技术底座、阶梯式算力布局和面向未来的架构设计,试图回答一个更关键的问题:当汽车进入物理AI时代,什么样的芯片,才真正配得上下一阶段的产业升级。

一、从座舱AI化到L4 Robotaxi 场景需求集中爆发行业呼唤新方案

随着大模型向端侧延伸、物理AI概念逐步落地,在这届北京车展上很明显能够看出汽车正在从“功能系统”组合演进为“持续运行的智能体”。

在这一过程中,辅助驾驶与车端AI的需求呈现出更明显的分层化、重模型化和复杂化特征,对底层芯片提出了新的系统性要求。

首先,需求正在快速分层。从座舱智能体、AI 语音与多模态交互,到城区辅助驾驶,再到L3/L4自动驾驶和Robotaxi,不同应用对算力规模、实时性、功耗控制、安全冗余以及模型适配能力的要求差异显著。

座舱侧更强调交互体验与能效平衡,城区辅助驾驶关注稳定推理与成本可控,而L3/L4场景则对算力上限、系统冗余和安全等级提出更高门槛。

这意味着,单一规格、单一定位的芯片方案,已经难以覆盖完整需求链条。行业开始需要能够横跨从座舱AI化到L4 Robotaxi的“连续型”算力与平台方案。

其次,随着VLA、世界模型等新一代模型形态逐步引入车端,模型规模更大、结构更复杂,传统通过简单堆叠算力来应对需求增长的思路正在接近瓶颈。

▲辅助驾驶需要更好的模型基座

车端AI的核心挑战不再只是峰值算力,而在于能否以合理的功耗和时延,高效运行复杂模型,并在实际车辆环境中长期稳定部署。

这背后考验的是芯片架构、算力利用率以及对模型的原生适配能力,而非单一参数指标。

第三,当应用场景分化、模型持续演进,芯片厂商的竞争重点也随之变化。

芯片能力不仅要覆盖多层级场景,还要兼顾开发效率、量产节奏和功能安全合规,形成可持续演进的技术底座。

因此,能够在统一架构下支持不同算力档位、不同应用形态的平台型芯片,更有机会成为下一阶段产业升级的关键支撑。

从这一角度看,行业并不缺“高参数”的芯片,真正稀缺的,是能够承接下一代模型上车,并支撑多场景规模化落地的平台型方案。

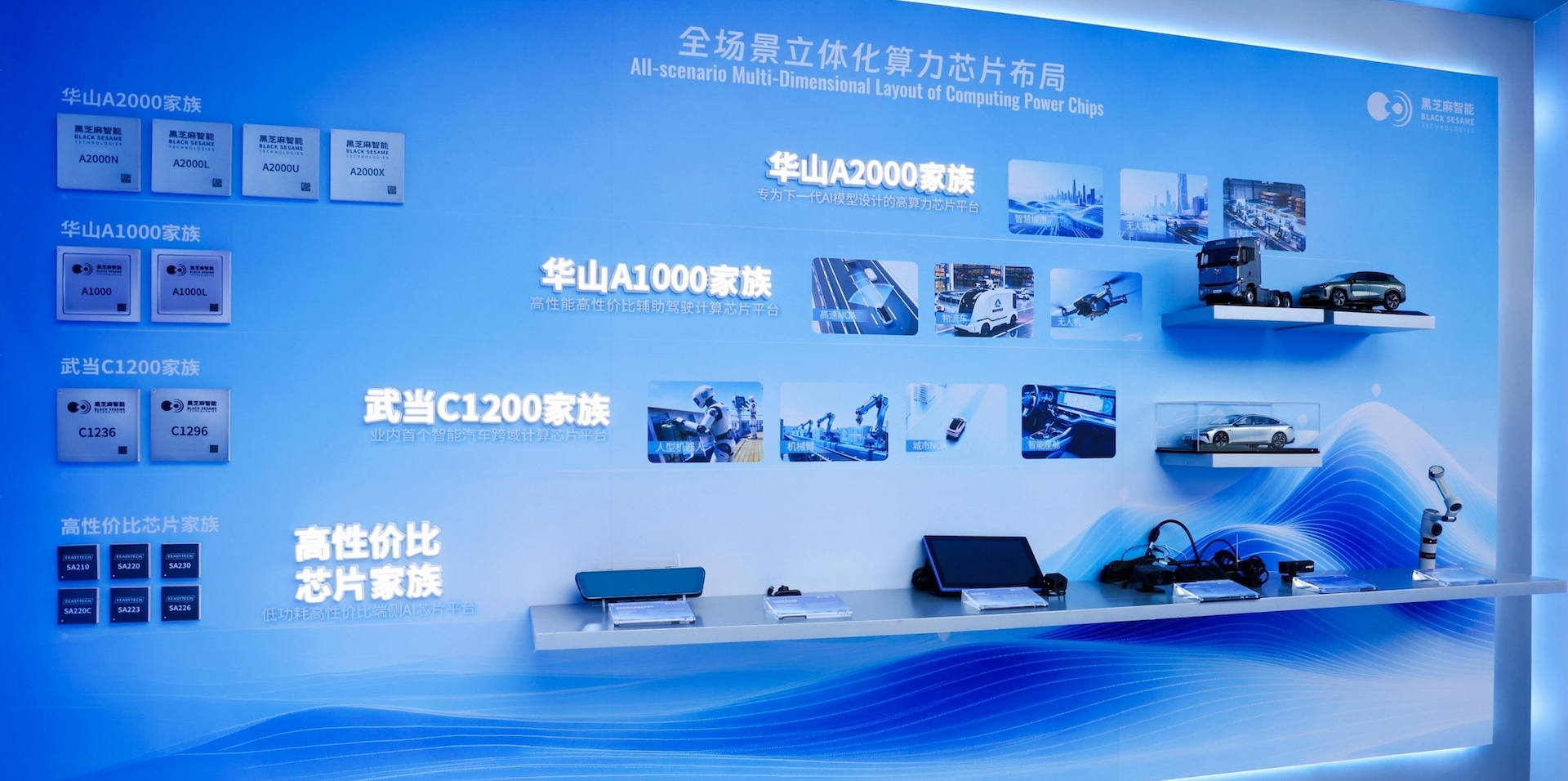

二、一套技术底座、四档产品布局 A2000把场景需求拆解成落地能力

在这一轮车端AI与辅助驾驶升级中,黑芝麻智能这次在车展中展出的新一代华山A2000系列高算力车规级AI芯片平台可以很好的解决这个问题。

华山A2000是一套基于统一技术底座构建的芯片家族,面向从座舱AI化到L4 Robotaxi的不同应用层级,提供阶梯式算力与能力配置。

在产品层面,华山A2000家族通过明确分工,对应不同层级的应用场景。

华山A2000N提供约200TOPS等效算力,主要面向座舱AI Box以及对成本和能效高度敏感的城区辅助驾驶场景,强调在有限算力预算下的稳定推理与性价比平衡。

华山A2000L和华山A2000N同源,将算力提升至400TOPS,定位高阶城区辅助驾驶需求,在感知规模、多任务并行和模型复杂度方面具备更充足冗余。

▲华山A2000U和华山A2000X

华山A2000U进一步提升至700TOPS,面向基于AI新范式的全场景辅助驾驶,更适配复杂模型结构和持续演进的算法需求。

而旗舰款的华山A2000X则以1000TOPS等效算力,瞄准拟人化AI司机、L3/L4和Robotaxi等高阶应用,同时支持多芯片协同扩展,为更长期的算力演进预留空间。

这种四档布局将不同阶段、不同车型的需求,纳入同一技术体系内进行规划。

需要指出的是,华山A2000并不是“只多了点算力”,而是围绕大模型与端侧部署进行了系统级设计。

在计算架构上,华山A2000系列搭载自研的九韶NPU,专为大模型推理设计,支持多种混合精度,FP16模型可直接运行,并针对Transformer类模型进行了针对性优化,目标是提升真实场景中的算力利用率,而非单纯追求峰值指标。

在数据路径上,华山A2000系列引入近存计算架构,配合百MB级高速片上缓存和最高8TB/s带宽,减少数据在片外频繁搬移带来的时延与功耗损耗,使算力更容易转化为可用性能。

在感知层面,华山A2000系列搭载了星眸ISP支持4曝光、150dB HDR与3DNR,并实现传感器RAW数据直通NPU,有助于在逆光、夜间、雨雪等复杂光照条件下提升感知稳定性,这类能力直接关系到高阶辅助驾驶与Robotaxi场景的可用边界。

在安全与工程层面,华山A2000系列采用“3L”功能安全设计,满足ASIL-D等级要求。

▲华山A2000系列

同时华山A2000系列还配套山海工具链,支持分钟级编译和 Triton 算子自动化编译,降低模型适配与系统集成复杂度,加快从算法开发到量产落地的整体节奏。

最终,华山A2000系列将场景分层、架构效率、安全能力和开发友好度,整合成了一套完整的平台能力。

这种平台化思路,使华山A2000系列产品更像是一套面向长期演进的端侧AI基础设施,把不同应用层级的需求,拆解并固化为真正可部署、可扩展、可量产的平台化能力。

三、从芯片到底座 产业进入下一阶段

2025年被普遍视为车端AI加速落地的关键一年。

多家研究机构数据显示,全球汽车AI市场规模在2025年已接近190亿美元(约合人民币1293亿元),预计到2030年将保持15%以上的年复合增长率。

其中,端侧AI计算相关硬件成为增长最快的细分方向之一。

这组数据背后,反映的是产业对车端算力角色认知的整体转变。

而黑芝麻智能此次重点展示的华山A2000系列产品就体现了芯片在竞争逻辑的变化。

随着模型规模和复杂度持续提升,行业逐渐意识到,单纯围绕TOPS指标竞争,已经难以准确衡量系统能力。

▲黑芝麻智能全场景立体化算力芯片布局

其中,黑芝麻智能的华山A2000产品线将重心前移到模型适配、系统效率和可演进性上,这本身就折射出芯片竞争逻辑的阶段性变化。

其次,华山A2000系列有望推动辅助驾驶能力进一步下沉。

从行业实践看,高阶辅助驾驶能力的规模化,往往受限于成本、功耗和系统复杂度。

市场预测显示,未来几年高阶智驾相关应用将成为增长最快的自动驾驶细分方向之一。

但从落地的角度来看,这样的市场前提是算力方案能够在不同车型和配置层级中灵活部署。

基于这一点,华山A2000系列通过统一技术底座下的多档产品布局,为不同算力需求提供连续选择,有助于降低高阶能力向更大规模车型扩展的工程门槛。

▲基于华山双A2000的域控

此外,随着VLA、世界模型等新范式逐步进入车端,模型更新节奏明显快于硬件迭代周期,产业需要的是能够承载模型持续演进的算力底座。

华山A2000系列产品在设计层面预留多芯片协同和长期扩展空间,本质上是在为不确定的未来模型形态提供接口级支撑,而非绑定某一代算法方案。

总体来看,在行业仍普遍围绕算力参数展开竞争的阶段,华山A2000系列产品已经将关注点推进到模型适配、系统效率与长期演进空间。

这也标志着,车端AI正从“选一颗更强的芯片”,走向“构建一套可持续演进的算力底座”。

而黑芝麻智能,已经在这一部分取得了先机。

结语:汽车芯片意义在被重新定义

当汽车进入模型驱动的新阶段,芯片的意义也在被重新定义。

它不再只是支撑某一项功能的硬件模块,而是决定车端AI能力上限、落地效率与演进空间的关键底座。

华山A2000家族的价值,恰恰在于它没有停留在“更高算力”的表层竞争,而是围绕多场景覆盖、架构效率、安全可靠与未来扩展,给出了更完整的答案。

对于正在加速分化又同步升级的行业而言,这样的平台,或许才真正代表下一阶段芯片竞争的方向。